Amazon Web Services (AWS) anunció la disponibilidad de sus nuevos Amazon EC2 Trn3 UltraServers, una solución de infraestructura diseñada para romper las barreras actuales de computación y redes que limitan el desarrollo de la inteligencia artificial generativa.

El panorama actual de la IA enfrenta un desafío crítico: a medida que los modelos crecen en complejidad y tamaño, la infraestructura tradicional se queda corta. Las organizaciones no solo luchan contra los costos prohibitivos, sino contra limitaciones físicas; simplemente aumentar el tamaño del clúster ya no garantiza un entrenamiento más rápido debido a las restricciones de paralelización, y las arquitecturas de instancia única son incapaces de manejar la inferencia en tiempo real de los modelos más modernos.

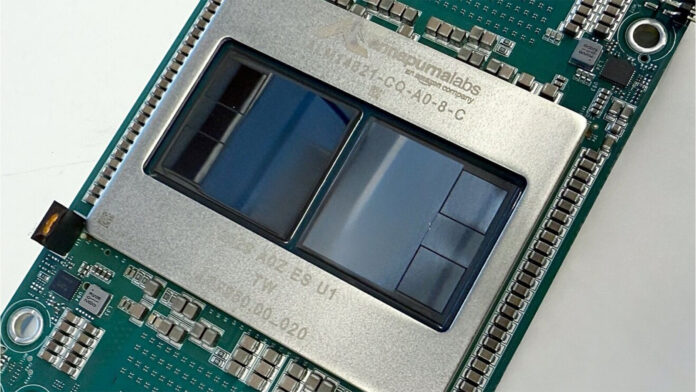

Para superar estos obstáculos técnicos, AWS ha lanzado los Trn3 UltraServers, impulsados por el nuevo chip Trainium3 construido con tecnología de proceso de 3nm. Esta arquitectura promete democratizar el acceso a la supercomputación, permitiendo a empresas de todos los tamaños entrenar modelos masivos y servir aplicaciones a escala con una eficiencia sin precedentes.

Potencia bruta y eficiencia energética

Los nuevos ultraServers representan un salto cuántico en densidad de procesamiento, empaquetando hasta 144 chips Trainium3 en un solo sistema integrado. Según las especificaciones técnicas, ofrece hasta 4.4 veces más rendimiento de cómputo que la generación anterior (Trainium2).

En pruebas de rendimiento utilizando el modelo de pesos abiertos GPT-OSS de OpenAI, los clientes lograron un throughput 3 veces mayor por chip y tiempos de respuesta 4 veces más rápidos. Además del rendimiento, el diseño del chip optimiza el consumo, ofreciendo una mejora del 40% en eficiencia energética, un factor clave para la sostenibilidad de los centros de datos modernos.

Redes diseñadas para la era de los «Sistemas Agénticos»

AWS ha abordado el cuello de botella de la comunicación mediante una integración vertical completa. El sistema incorpora el nuevo NeuronSwitch-v1, que duplica el ancho de banda dentro de cada servidor, y una red Neuron Fabric mejorada que reduce los retrasos de comunicación entre chips a menos de 10 microsegundos. Esta latencia ultrabaja es vital para cargas de trabajo avanzadas, como las mezclas de expertos (MoE) y sistemas agénticos, que requieren flujos de datos masivos casi instantáneos.

Para necesidades de escala extrema, AWS presentó los EC2 UltraClusters 3.0, capaces de interconectar miles de servidores para sumar hasta 1 millón de chips Trainium —10 veces más que la generación previa—, habilitando el entrenamiento de modelos multimodales sobre conjuntos de datos de billones de tokens.